Lange Zeit war die Sicherheitslogik im Unternehmen relativ klar. Daten sollten geschützt, Zugriffe begrenzt, Systeme gehärtet und Prozesse sauber dokumentiert werden. Wer über Datenschutz sprach, meinte in erster Linie die Kontrolle über gespeicherte und übertragene Informationen, während IT-Sicherheit vor allem mit Themen wie Zugriffsrechten, Verschlüsselung, Netzwerken, Backups und Audits verbunden wurde.

Mit dem Einsatz generativer KI verschiebt sich dieser Fokus jedoch spürbar. Daten werden nicht länger ausschließlich innerhalb klar abgegrenzter Anwendungen verarbeitet, sondern dienen zunehmend als Input für Systeme, die Muster erkennen, eigenständig Inhalte erzeugen, Entscheidungen vorbereiten und in vielen Fällen sogar direkt in Geschäftsprozesse eingreifen.

Dieser Beitrag zeigt, warum klassische Sicherheits- und Datenschutzkonzepte allein nicht mehr ausreichen, welche neuen Risiken durch den Einsatz von KI entstehen und welche grundlegenden Fragen Unternehmen künftig früher und klarer beantworten müssen

KI ist längst Teil des Arbeitsalltags und verschiebt den Umgang mit sensiblen Informationen

Mitarbeitende greifen immer häufiger zu niedrigschwelligen KI-Werkzeugen: sei es über Chatfenster im Browser, Desktop-Apps, Copilots in Office-Umgebungen oder direkt eingebettete Assistenten in Fachsoftware.

Gerade unter Zeitdruck wird es naheliegend, Inhalte schnell in ein KI-Tool zu kopieren, etwa Vertragstexte, E-Mails, Support-Anfragen oder interne Berichte. Die Nutzung ist einfach, unmittelbar und oft ohne technische Hürden möglich.

Gleichzeitig bleibt für viele Nutzerinnen und Nutzer unklar, wo und wie diese Daten verarbeitet werden. Ob eine Anwendung lokal arbeitet oder Inhalte im Hintergrund an externe Cloud-Infrastrukturen überträgt, ist häufig nicht transparent. Dadurch verschwimmt die Grenze zwischen der Nutzung eines Tools und der tatsächlichen Weitergabe sensibler Informationen.

Genau diese Kombination macht KI-Tools zu einem relevanten Sicherheitsfaktor. Generative KI ist längst kein Spezialwerkzeug mehr , sondern hat sich zu einem Standardzugang für Arbeit, Information und Textproduktion entwickelt.

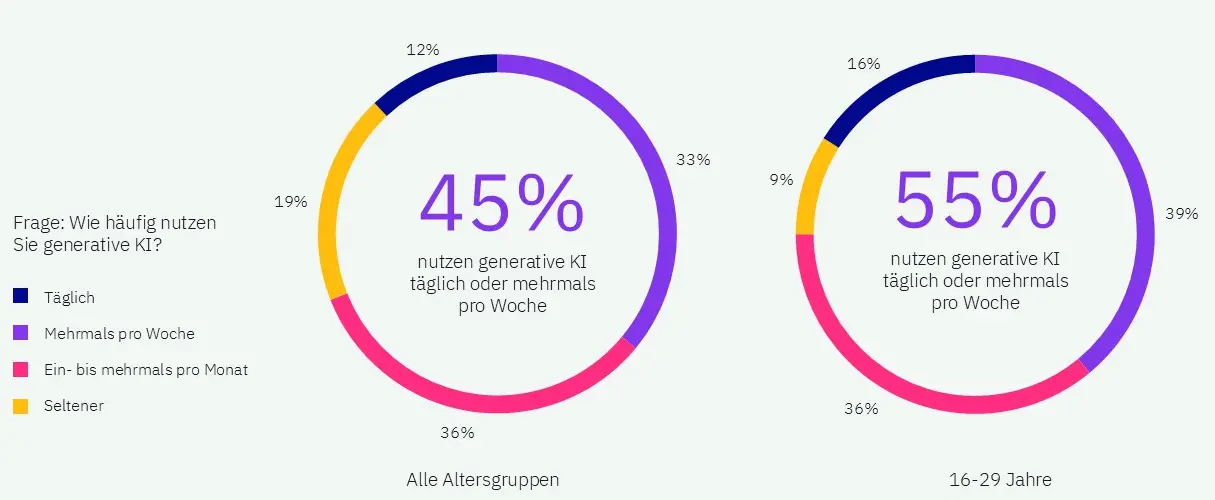

Abbildung 1: Fast jede:r Zweite

nutzt KI mehrmals pro Woche

Quelle: Eigene Darstellung in Anlehnung an TÜV-Verband (2025): ChatGPT-Studie 2025 – Präsentation zur Pressekonferenz. Verfügbar unter:

Mit der zunehmenden Nutzung von KI verschieben sich auch die sicherheitsrelevanten Fragestellungen, denn sie entstehen nicht mehr erst am Ende eines Prozesses, sondern genau in dem Moment, in dem solche Tools aktiv genutzt werden.

Klassische Sicherheitsprinzipien bleiben, reichen aber nicht mehr als alleinige Antwort

Die bisherigen Anforderungen verschwinden keineswegs, im Gegenteil: Zentrale Prinzipien bleiben weiterhin unverzichtbar. Dazu zählen insbesondere :

- klare Regeln, wer auf welche Daten zugreifen darf

- der Schutz von Daten bei Speicherung und Übertragung

- DSGVO-Prinzipien wie Zweckbindung und Datenminimierung

- Die Nachvollziehbarkeit von Zugriffen und Abläufen

Diese Logik wurde bislang vor allem auf Systeme angewendet, die nach festen Regeln arbeiten. Sie verarbeiteten Daten, entwickelten sich jedoch nicht eigenständig auf deren Basis weiter.

Im Kern ging es daher lange um eine relativ klare Frage: Wer darf auf Daten zugreifen, wo werden sie gespeichert und wie werden sie geschützt?

Mit dem Einsatz von KI greift diese Perspektive jedoch nicht mehr weit genug. Es entstehen zusätzliche Risiken, die durch klassische Sicherheitsmodelle nicht vollständig abgedeckt werden. Sensible Informationen finden sich in Prompts wieder, während Entscheidungen in Systemen entstehen, deren Ergebnisse nicht immer nachvollziehbar sind. Zudem bleibt häufig unklar, ob und wie Eingaben gespeichert oder weiterverwendet werden.

Gleichzeitig nimmt die sogenannte Schattennutzung zu, da viele KI-Werkzeuge frei verfügbar sind und außerhalb etablierter Strukturen genutzt werden.

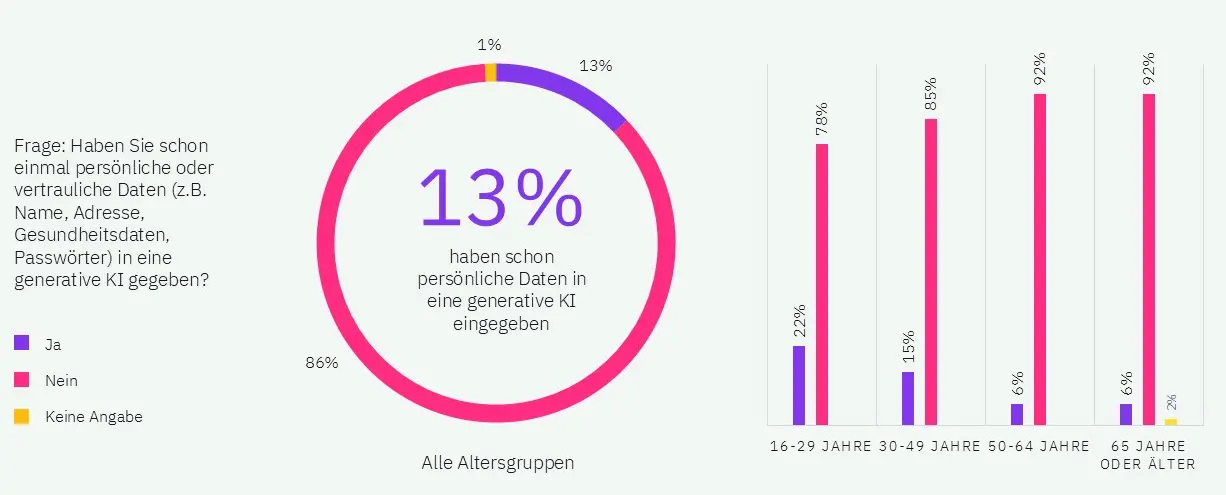

Ein Beispiel aus dem Arbeitsalltag macht das greifbar: Eine Mitarbeiterin prüft eine Vertragsklausel und gibt Passagen in einen frei zugänglichen Assistenten ein, um Risiken markieren und Alternativen formulieren zu lassen. Für sie ist das ein effizienter Weg zum Ergebnis – aus Unternehmenssicht wurden jedoch möglicherweise sensible Inhalte in ein System eingegeben, das nicht Teil der eigenen Governance ist. Dieses Verhalten ist kein Einzelfall, sondern lässt sich auch empirisch beobachten:

Abbildung 2: Jede:r Achte teilt

persönliche oder vertrauliche Daten

Quelle: Eigene Darstellung in Anlehnung an TÜV-Verband (2025): ChatGPT-Studie 2025, Präsentation zur Pressekonferenz*

Das eigentliche Problem liegt deshalb nicht allein im möglichen Datenabfluss, sondern in einer Kombination mehrerer Faktoren: einer sehr niedrigen Nutzungsschwelle, fehlender Transparenz darüber, was im Hintergrund geschieht, und Systemen, die aus eingegebenen Daten eigenständig neue Inhalte und Entscheidungsgrundlagen erzeugen.

Welche Anforderungen Unternehmen für den Einsatz von KI neu definieren müssen

Wenn Daten Teil eines lernenden oder ableitenden Systems werden, reichen allgemeine Richtlinien nicht mehr aus. Unternehmen brauchen operativ wirksame Regeln.

Dabei rücken vier Aspekte besonders in den Mittelpunkt:

1. Klare Regeln für KI-Nutzung und Datenfreigabe

Nicht jede Information gehört in jedes Tool. Deshalb müssen Teams genau wissen, welche Daten bedenkenlos genutzt werden können und welche ausschließlich in geschützten oder internen Umgebungen verarbeitet werden dürfen.

2. Kontrolle über Datenverarbeitung und Infrastruktur

Entscheidend ist nicht, wie ein Tool aussieht, sondern was im Hintergrund passiert. Sicherheit hängt davon ab, wo und wie Daten tatsächlich verarbeitet werden und ob das unter eigener Kontrolle geschieht.

3. Transparenz und Nachvollziehbarkeit

Unternehmen müssen nachvollziehen können, wie Ergebnisse entstehen. Nur so lässt sich beurteilen, ob Outputs verlässlich sind und an welchen Stellen eingegriffen oder korrigiert werden kann.

4. Verbindliche KI-Governance

Sobald KI in Prozesse eingebunden ist, braucht es klare Regeln für Zuständigkeiten und Entscheidungen. Es muss eindeutig festgelegt sein, wer Verantwortung trägt und welche Leitplanken für den Einsatz gelten.

Warum KI-Sicherheit zur Führungsaufgabe wird

Die Diskussion rund um KI beginnt in vielen Unternehmen zunächst bei IT-Security, Datenschutz oder Legal. Tatsächlich reicht das Thema jedoch sehr schnell weit darüber hinaus und berührt zentrale geschäftliche Fragen – etwa Geschwindigkeit, Produktivität, Qualität, Risiko und Verantwortung.

Denn generative KI skaliert nicht nur den Nutzen, sondern auch potenzielle Fehler. Wenn ein unzureichend kontrolliertes System falsche Empfehlungen erzeugt oder sensible Inhalte unbeabsichtigt in Prozesse einfließen, ist das kein isoliertes IT-Thema mehr, sondern eine Frage der unternehmerischen Steuerung.

Fazit: Datenschutz allein reicht nicht, entscheidend sind klare Regeln für den KI-Einsatz

Mit dem Einsatz von KI reicht klassischer Datenschutz allein nicht mehr aus. Die bekannten Prinzipien bleiben zwar wichtig, genügen jedoch nicht mehr als alleinige Antwort. Unternehmen müssen zusätzlich klären, wie sie die Nutzung von KI steuern, welche Datenräume unter Kontrolle bleiben, wie Transparenz geschaffen wird und wer letztlich Verantwortung trägt.

Damit verschiebt sich auch die zentrale Fragestellung: Es geht nicht mehr nur darum, welches Tool eingesetzt wird, sondern unter welchen Bedingungen und mit welchen Regeln KI im Unternehmen genutzt wird.

Takeaway der Beitragsserie „KI sicher einsetzen" (1/6):

KI verändert nicht nur die Effizienz von Arbeit, sondern die Sicherheitslogik dahinter. Daten werden nicht nur geschützt, sondern Teil von Systemen, die daraus Inhalte, Muster und Entscheidungen ableiten.

In dem nächsten Teil der Serie "KI sicher einsetzen" (2/6) geht es um die zentrale Frage, die sich daraus ergibt: Wie souverän Unternehmen ihre KI-Systeme tatsächlich betreiben und wer die Kontrolle über Daten, Modelle und Entscheidungen behält.

*Studienergebnisse verfügbar unter: https://www.tuev-verband.de/fileadmin/user_upload/Content_local/2025_TUEV-Verband_ChatGPT-Studie_Praesentation_PK.pdf