Im zweiten Teil der Serie ging es um die Frage, wie Unternehmen die Kontrolle über ihre KI-Systeme behalten können. Im Mittelpunkt stand dabei der Begriff Souveränität – also die Fähigkeit, Daten, Modelle und Entscheidungen bewusst zu steuern.

Doch genau an diesem Punkt stellt sich die nächste Frage: Wodurch wird diese Kontrolle eigentlich praktisch umgesetzt?

Genau hier wird Infrastruktur relevant. Denn sobald KI mit sensiblen Daten, internen Prozessen oder geschäftskritischen Entscheidungen arbeitet, ist Infrastruktur weit mehr als ein technisches Fundament im Hintergrund. Sie bestimmt, wo Daten verarbeitet werden, wer Zugriff hat, wie Risiken begrenzt werden können und ob Unternehmen im Ernstfall überhaupt eingreifen können.

Dieser Beitrag zeigt, warum Infrastruktur im KI-Kontext kein Technikdetail ist, welche Ebenen eines KI-Setups dabei eine Rolle spielen und weshalb Sicherheit und Souveränität vor allem in den tieferen technischen Schichten entstehen.

Die entscheidenden Sicherheitsfragen liegen nicht im sichtbaren System

Viele KI-Projekte beginnen dort, wo der Nutzen sichtbar wird: bei Chatbots, Copilots, Automatisierung oder konkreten Anwendungsfällen. Das ist nachvollziehbar, denn genau dort entsteht der unmittelbare Mehrwert.

Was dabei oft unterschätzt wird: Die eigentliche Steuerung von KI findet nicht auf dieser Ebene statt.

Die Anwendungen, die Mitarbeitende im Alltag nutzen, sind nur ein Teil des Gesamtsystems. Entscheidend ist, was im Hintergrund passiert: Dort wird festgelegt, wo Inhalte verarbeitet werden, wer Zugriff hat, unter welchen rechtlichen Rahmenbedingungen das System betrieben wird und wie schnell im Ernstfall reagiert werden kann.

Diese Aspekte sind im Alltag kaum sichtbar, sie bestimmen aber, ob ein KI-System sicher und steuerbar ist oder nicht. Gerade deshalb ist Infrastruktur bei KI nicht nur ein technisches Fundament, sondern die praktische Umsetzung von Kontrolle.

Vier Ebenen bestimmen Aufbau und Sicherheit von KI-Systemen

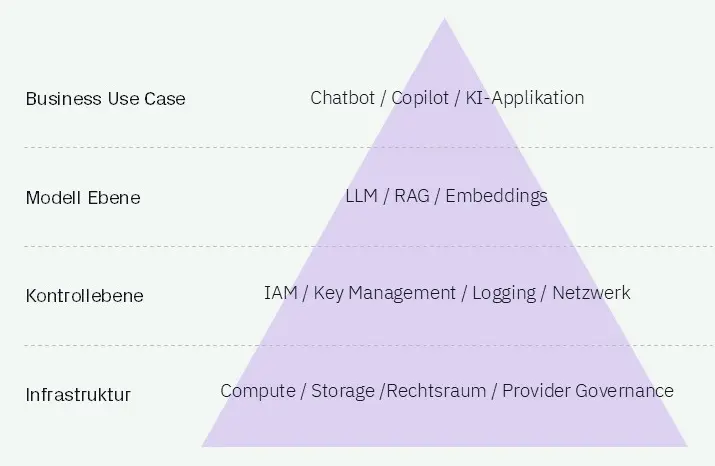

Um diese Zusammenhänge greifbarer zu machen, hilft eine einfache Einteilung in vier Ebenen. Sie zeigt, dass Sicherheit nicht an der Oberfläche entsteht, sondern vor allem in den darunterliegenden Schichten.

Ganz oben steht die Anwendungsebene. Hier findet die Nutzung statt, etwa in Form eines Chatbots, Copilots oder einer KI-gestützten Fachanwendung. Diese Ebene ist sichtbar und liefert den direkten Mehrwert.

Darunter liegt die Ebene der Modelle und KI-Funktionen. Hier werden Eingaben verarbeitet und Ergebnisse erzeugt. Diese Ebene ist zentral für die Funktionsweise, aber nicht die einzige Stelle, an der Risiken entstehen.

Die nächste Ebene ist die Steuerungs- und Sicherheitsebene. Hier wird festgelegt, wer auf was zugreifen darf, welche Regeln gelten und wie Systeme überwacht werden. Dazu gehören Zugriffsrechte, Protokollierung und Kontrollmechanismen. Diese Ebene entscheidet darüber, ob Vorgaben im Alltag tatsächlich eingehalten werden können.

Erst darunter folgt die technische Infrastruktur. Sie bildet die Grundlage des gesamten Systems und legt fest, wo Daten verarbeitet werden, wer die Systeme betreibt und in welchem rechtlichen Rahmen sie laufen.

Abbildung 3: Vier Ebenen des KI-Betriebs: von der Anwendung bis zur Infrastruktur

Diese Einordnung macht deutlich: KI-Sicherheit entsteht nicht im sichtbaren Tool, sondern vor allem in den Ebenen darunter.

Infrastruktur legt fest, wie sicher und kontrollierbar KI-Systeme sind

Die technische Infrastruktur bestimmt, wie viel Kontrolle ein Unternehmen im KI-Betrieb tatsächlich hat und wie handlungsfähig es im Ernstfall ist.

Sie legt zunächst fest, wo Daten verarbeitet werden und unter welchen Bedingungen das geschieht. Gerade bei sensiblen Informationen ist entscheidend, ob diese innerhalb kontrollierter Umgebungen bleiben oder in externe Systeme fließen, auf die nur begrenzter Einfluss besteht.

Gleichzeitig bestimmt sie, wer Zugriff auf Systeme und Informationen hat. Wer kann Daten einsehen? Wer kann Einstellungen verändern? Und wer ist in der Lage, bei einem Vorfall einzugreifen? Diese Fragen lassen sich nicht auf Anwendungsebene beantworten, sondern nur über die zugrunde liegende technische Struktur.

Ein weiterer entscheidender Punkt ist die Reaktionsfähigkeit. Wenn ein System fehlerhafte oder riskante Ergebnisse liefert, kommt es darauf an, wie schnell und gezielt reagiert werden kann. Ob sich Prozesse stoppen, isolieren oder korrigieren lassen, hängt nicht von der KI-Anwendung selbst ab, sondern davon, wie sie betrieben wird.

Schließlich bestimmt die Infrastruktur auch, wie gut sich der Betrieb nachvollziehen lässt. Unternehmen müssen im Zweifel erklären können, wie ein System funktioniert, wer darauf zugegriffen hat und wie mit Risiken umgegangen wurde. Ohne diese Transparenz bleiben viele Governance-Vorgaben in der Praxis schwer überprüfbar.

Warum Infrastruktur auch über Abhängigkeit und Zukunftsfähigkeit entscheidet

Neben Sicherheit und Kontrolle hat Infrastruktur noch eine weitere Dimension, die häufig unterschätzt wird: Sie beeinflusst, wie abhängig ein Unternehmen von einzelnen Anbietern oder Technologien wird.

Je stärker KI in Prozesse integriert ist, desto schwieriger wird es, Systeme zu wechseln oder anzupassen. Entscheidungen, die heute rein technisch wirken, legen damit langfristig fest, wie flexibel ein Unternehmen bleibt und wie groß seine Handlungsspielräume sind.

Gleichzeitig ist der Zugang zu Rechenkapazität, Cloud-Infrastruktur und KI-Plattformen zunehmend politisch und wirtschaftlich geprägt. Diskussionen rund um digitale Souveränität, europäische Rechenzentren oder sogenannte AI Factories machen deutlich, dass es nicht nur um Technologie geht, sondern auch um Kontrolle, Abhängigkeiten und Wettbewerbsfähigkeit.

Ein zentraler Punkt dabei ist die ungleiche Verteilung von Rechenleistung. Große Teile der globalen Infrastruktur liegen bei wenigen Anbietern. Das beeinflusst, wie schnell Innovation entsteht, wie unabhängig Unternehmen agieren können und wie leicht sich bestehende Lösungen weiterentwickeln oder ersetzen lassen.

Für Unternehmen bedeutet das: Mit der Wahl der KI-Infrastruktur wird festgelegt, wie flexibel ein Setup bleibt, wie groß die Abhängigkeit von Anbietern ist und wie zukunftsfähig der KI-Einsatz gestaltet werden kann.

Checkliste: Zentrale Fragen für einen steuerbaren KI-Einsatz

In der Praxis zeigt sich immer wieder, dass Infrastrukturfragen zu spät gestellt werden, oft erst dann, wenn Anwendungen bereits im Einsatz sind.

Sinnvoll ist es, diese Fragen von Anfang an mitzudenken. Dazu gehören insbesondere:

- Wo werden Daten verarbeitet und gespeichert?

- Wer hat Zugriff auf Systeme und Informationen?

- Wie werden Zugriffe kontrolliert und nachvollziehbar gemacht?

- Welche Möglichkeiten gibt es, bei Problemen einzugreifen?

- Wie lassen sich Risiken im Ernstfall begrenzen?

- Wie abhängig ist das Setup von einzelnen Anbietern?

Wer diese Fragen frühzeitig klärt, schafft eine stabile Grundlage für den KI-Einsatz und vermeidet spätere Anpassungen.

Fazit: Frühe Infrastrukturentscheidungen sichern langfristige Kontrolle

Im KI-Kontext ist Infrastruktur kein nachgelagerter Aspekt, sondern die Grundlage dafür, ob ein Unternehmen seine Systeme tatsächlich steuern kann.

Viele Entscheidungen, die auf den ersten Blick technisch wirken, bestimmen in der Praxis, wie mit Daten umgegangen wird, wer Zugriff hat und wie gut sich Risiken kontrollieren lassen. Genau dort wird festgelegt, ob Sicherheit und Governance im Alltag funktionieren – oder nur auf dem Papier existieren.

Wer Infrastruktur zu spät berücksichtigt, schafft Fakten, die sich später nur mit hohem Aufwand korrigieren lassen. Wer sie früh einbezieht, legt die Grundlage für einen KI-Einsatz, der dauerhaft steuerbar bleibt.

Takeaway der Beitragsserie „KI sicher einsetzen“ Teil 3:

KI wird nicht dort kontrolliert, wo sie sichtbar ist. Die eigentliche Kontrolle entsteht in der Architektur und im Betrieb der Systeme.

Im nächster Beitrag der Serie wir thematisiert, warum Cloud nicht gleich Cloud und welche Betriebsmodelle Unternehmen tatsächlich zur Wahl haben.