Große Sprachmodelle (LLMs) wie GPT-4 oder Claude beeindrucken mit erstaunlichen Fähigkeiten und doch scheitern sie im Geschäftsalltag oft an einfachen Fragen, weil ihnen der Zugriff auf unternehmensspezifische Informationen oder Systeme fehlt. Der Grund: Selbst die fortschrittlichsten KI-Systeme bleiben ohne Weiteres isoliert von den Daten in unseren Firmen. Auch aus einer anderen Perspektive zeigt sich das gleiche Problem: KI-Modelle können Unternehmensanwendungen oder Prozesse nur dann sinnvoll steuern, wenn die Verbindung zu diesen Systemen stabil und sauber definiert ist. Doch genau daran scheitert es oft – denn solche Anbindungen über APIs oder andere Schnittstellen müssen meist aufwendig individuell entwickelt werden. Das kostet nicht nur Zeit, sondern macht wirklich integrierte KI-Lösungen schwer skalierbar. Die Folge: KI bleibt häufig eine Insellösung getrennt von den eigentlichen Daten, Systemen und Workflows im Unternehmen. Genau hier kommt das Model Context Protocol (MCP) ins Spiel. In diesem Beitrag zeigen wir, wie MCP genau diese Lücke schließt und warum es sich zum Schlüsselstandard für den produktiven KI-Einsatz im Unternehmen entwickelt. Außerdem werfen wir einen kompakten Blick auf Vorteile, Architektur und konkrete Anwendungsszenarien.

Model Context Protocol (MCP): Der Verbindungsstandard zwischen KI und Unternehmenswelt

Das MCP setzt genau an der fehlenden Brücke zwischen KI und Unternehmenssystemen an. Als offener Standard sorgt es dafür, dass KI-Modelle nicht länger isoliert agieren, sondern gezielt mit den Systemen interagieren können, in denen die relevanten Daten und Funktionen leben – von Content-Repositories über Business-Anwendungen bis hin zu Entwickler-Tools. Man kann es sich als “USB-C Stecker für KI” vorstellen: Ein einheitlicher Anschluss, über den Datenquellen und Software-Applikationen mit einem KI-System verbunden werden können. System-/Softwarehersteller können diese Anbindung einmal definieren und jeder kann diesen "Stecker" dann bei Bedarf mit seinem LLM-System verbinden. Das Resultat ist eine einfache standardisierte und zuverlässige Möglichkeit, KI-Systemen genau die Informationen und Applikationszugänge bereitzustellen, die sie brauchen.

Warum ist das wichtig? Weil KI so vom isolierten Chatbot zum wirklich geschäftstauglichen Assistenten reift. MCP ist erst Ende 2024 von Anthropic (den Entwicklern von Claude) als offenes, standardisiertes Protokoll zur Integration von KI-Systemen mit externen Anwendungen (Open Protocol) vorgestellt worden und zieht seitdem breite Aufmerksamkeit auf sich. Große Player springen bereits auf den Zug auf – Mircosoft will es sogar in Windows integrieren und Google baut mit seinem Agent2Agent Framework das Prinzip noch weiter aus. Kurz: MCP entwickelt sich zum möglichen Branchenstandard im Zusammenspiel von KI und Geschäftsprozessen.

Welche Vorteile bietet MCP?

MCP bringt handfeste Vorteile mit sich, die für Entscheider relevant sind – von der IT-Strategie bis zur Kostenrechnung:

- Einheitliche Integration, Flexibilität & Unabhängigkeit: Anstatt für jede Datenquelle oder jedes Tool eine separate Schnittstelle zu entwickeln, gibt es einen Standardweg. Eine MCP-Schnittstelle kann prinzipiell jedes Large Language Model mit jedem externen Tool verbinden – ob Datenbank, CRM oder E-Mail-API. Das erleichtert bereichsübergreifende Lösungen und schafft Vendor-Lock-in-Freiheit.

- Beschleunigte Entwicklung: Durch standardisierte Abläufe für Datenzugriff und Tool-Ausführung sinkt der Entwicklungs- und Wartungsaufwand deutlich. Statt das Rad ständig neu zu erfinden, können Teams auf vorhandene MCP-Integrationen zurückgreifen und sich auf die business-spezifische Logik konzentrieren.

- Sichere Dateneinbindung: Der Kontext bleibt unter Kontrolle des Unternehmens. MCP setzt auf bewährte Sicherheitsmechanismen und erlaubt es, Daten innerhalb der eigenen Infrastruktur bereitzustellen. Zugriffsbeschränkungen, Authentifizierung und Protokollierung sind standardisiert, was Compliance und Governance vereinfacht. Sensible Daten wandern nicht planlos in eine Cloud-KI, sondern werden gezielt und nachvollziehbar über MCP geteilt.

Diese Vorteile sind kein bloßes Versprechen, sie lassen sich bereits beobachten. So existiert schon jetzt eine wachsende Bibliothek an vorgefertigten MCP-Konnektoren (sog. MCP-Servern) für gängige Systeme wie Google Drive, Slack, GitHub, Zapier, Postgres-Datenbanken u.v.m. MCP ist auf dem besten Weg, sich als De-facto-Standard zu etablieren, um KI-Systeme geschäftstauglich zu machen.

Architektur & Komponenten

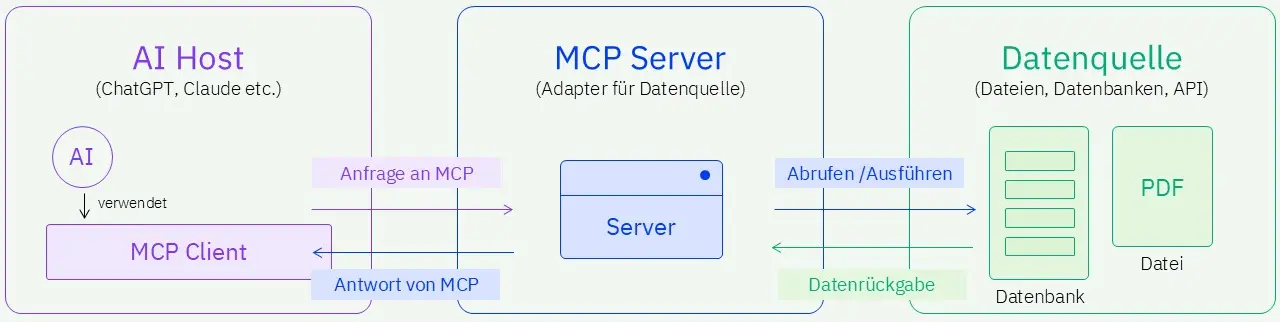

Die MCP-Architektur ist bewusst einfach gehalten und in folgendem Bild zusammengefasst:

MCP Server

Ein MCP Server ist die zentrale technische Komponente, über die ein KI-System auf externe Tools, Datenquellen oder Anwendungen zugreifen kann – etwa auf ein E-Mail-System, eine Datenbank oder ein internes Ticketsystem. Für jedes angebundene System wird in der Regel ein eigener MCP Server bereitgestellt. In der Architektur (in der Mitte der Abbildung zu sehen) bildet er die Verbindung zwischen dem KI-System (links) und den externen Systemen (rechts) und stellt die dafür nötige Funktionalität bereit.

Damit die Kommunikation reibungslos funktioniert, folgt der Server einem klar definierten Standard: dem MCP-Protokoll. Es regelt, wie ein Server seine Dienste strukturiert und dem KI-System zur Verfügung stellt. Dabei unterscheidet das Protokoll drei Kategorien:

- Tools: Ausführbare Aktionen, die von der KI gezielt aufgerufen werden können – z. B. „E-Mails abrufen“, „Kalendereintrag erstellen“ oder „Support-Ticket anlegen“.

- Resources: Inhalte oder Datenquellen, auf die die KI zugreifen kann – wie Dokumente, Datenbankabfragen oder Wissensartikel.

- Prompts: Vorgefertigte Anweisungen oder Textbausteine, die der KI helfen, Aufgaben im gewünschten Stil oder mit klarem Fokus zu lösen.

Beim Verbindungsaufbau teilt ein MCP Server dem KI-System mit, welche dieser Dienste verfügbar sind. Die KI kann diese dann gezielt einsetzen, wenn sie für eine Nutzeranfrage relevant sind – etwa, um Informationen abzurufen, Prozesse anzustoßen oder kontextgerechte Antworten zu formulieren.

AI Host

"Host" bezeichnet die KI-Software über die mit dem LLM interagiert wird. Das kann eine Anwendung wie OpenAIs ChatGPT, Anthropics Claude Desktop oder ein Coding-Editor wie Cursor sein. Hier können MCP Server Verbindungen leicht eingerichtet werden, sodass die KI dann in der Lage ist diese zu nutzen. Nach der Einrichtung der Verbindung, wird der KI immer mitgegeben welche MCP Server zur Verfügung stehen und welche Dienste (Tools, Resouces und Prompts) diese anbieten. Die KI kann dann bei Anfragen entscheiden, ob es sinnvoll ist diese zu nutzen. Falls ja, schickt sie eine entsprechende Anfrage an den MCP Server. Für die Verbindung zum Server wird ein "Client" verwendet.

Der MCP Client ist Teil der Host-Applikation und im Grunde ein leichtgewichtiges Verbindungsstück zu einem MCP Server. Für jeden MCP Server, der angesprochen werden soll, gibt es in der Host-Applikation einen Client, der sich um die Kommunikation kümmert.Die Kommunikation zwischen MCP Client und MCP Server erfolgt über JSON-RPC 2.0, was eine standardisierte und effiziente Interaktion zwischen den Komponenten ermöglicht. Übrigens: Das MCP Protokoll erlaubt es auch, dass der MCP Server Anfragen an den Client schicken kann. Etwa, um selbst das LLM zu nutzen oder um den menschlichen Nutzer nach Details zu fragen.

Konkreter Ablauf

Um einmal zu verdeutlichen, wie genau ein MCP Server eingesetzt werden kann, verwenden wir folgendes Beispiel: Wir nutzen ChatGPT und möchten, dass die KI auch auf unsere E-Mails zugreifen kann. Unsere E-Mails liegen auf einem Mail-Server des Anbieters MyMail. Wir nehmen an, dass MyMail bereits einen MCP Server implementiert hat und seinen Kunden zugänglich gemacht hat (oder es in der open-source community bereits einen passenden MCP Server gibt). Alles, was jetzt noch getan werden muss, ist in ChatGPT einen "Custom Connector" anzulegen - dafür muss nur die URL des MCP Servers eingetragen werden. Das wars: Plug & Play sozusagen. Wenn ich jetzt eine Frage oder Anweisung an ChatGPT schicke, werden verfügbaren MCP Server gesammelt und angebunden. Die MCP Server melden welche Dienste sie zur Verfügung stellen, und so weiß die KI auf welche Dienste sie zugreifen kann. Schreibe ich "Bitte fasse meine Emails von heute zusammen", versteht die KI, dass sie dafür den MCP Server von MyMail nutzen sollte. Dieser bietet dann zum Beispiel das Tool "get_mails()" an, dass die KI dann mit passenden Parametern (für den Tag z.B.) aufruft. Der Server führt das entsprechende Tool aus und kümmert sich darum die Mails als Antwort an die KI zu schicken.

Geschäftsnahe Anwendungsbeispiele

Zum Abschluss ein Blick in die Praxis: Wie könnten MCP-gestützte KI-Systeme ganz konkret in verschiedenen Unternehmensbereichen Nutzen stiften? Hier drei Szenarien, die zeigen, was möglich ist:

Kundenservice:

Stellen Sie sich einen Chatbot im Kundenservice vor, der nicht nur auf ein statisches FAQ zugreift, sondern über MCP direkt in Echtzeit Informationen aus internen Wissensdatenbanken, CRM-Systemen und Ticketing-Tools ziehen kann. Fragt ein Kunde nach dem Status seiner Bestellung, ruft der Bot via MCP die ERP-Daten ab und gibt eine präzise Antwort. Komplexere Anfragen? Der Bot kann relevante Produktdokumentationen aus dem Intranet laden oder sogar einen Rückruf durch den Support einplanen, indem er ein CRM-Tool auslöst. Das Ergebnis: Schnellere, konsistentere Auskünfte und eine höhere Erstlösungsquote – während menschliche Support-Mitarbeiter entlastet werden und sich auf kniffligere Fälle konzentrieren können.

Wissensmanagement & internes Coaching:

In vielen Unternehmen suchen Mitarbeiter täglich Informationen – zu Prozessrichtlinien, IT-Prozeduren oder HR-Regelungen. Mit MCP lässt sich ein interner KI-Assistent realisieren, der all diese verteilten Wissensquellen bündelt. Er könnte via MCP auf das Unternehmens-Wiki, SharePoint-Dokumente, E-Mail-Archive oder sogar auf Kollaborations-Tools wie Slack zugreifen. Neue Kollegen fragen den virtuellen Coach z.B.: "Wie beantrage ich Urlaub?" – und der Assistent liefert die Antwort direkt aus dem HR-Handbuch, inklusive Link zur passenden Formular-Seite. Das spart Zeit und reduziert Frustration: Wissen wird auffindbar, ohne dass jeder Mitarbeiter zum Suchmaschinen-Profi werden muss. Gleichzeitig bleibt die Kontrolle gewahrt, weil Zugriffe über MCP gezielt eingegrenzt sind (der Vertrieb sieht z.B. nur Vertriebsdokumente, nicht die Finanzakten).

Vertrieb & Marketing:

Im Vertrieb zählen Tempo und Personalisierung. Mit MCP kann man z.B. einen Vertriebs-Copilot realisieren, der Kundenkommunikation vorbereitet. Er greift über MCP auf das CRM zu (Kundendaten, letzte Kontakte), holt sich aktuelle Produktpreise und Lagerinfos aus dem ERP und nutzt vielleicht noch einen Newsfeed, um branchenspezifische Neuigkeiten einzubeziehen. Daraus generiert er in Minuten einen auf den Kunden zugeschnittenen Angebotsentwurf oder eine Präsentation – etwas, wofür ein Account Manager sonst Stunden bräuchte, Informationen manuell zu sammeln. Auch Follow-ups ließen sich automatisieren: Nach einem Kundengespräch bittet der Mitarbeiter den KI-Assistenten, ein Meeting-Protokoll zu erstellen und direkt im CRM als Aktivität zu loggen (der Assistent nutzt die CRM-API via MCP-Tool). So wird kein Lead vergessen. Das Vertriebsteam kann sich auf die Beziehungspflege fokussieren, während Routineaufgaben und Informationsbeschaffung von der KI erledigt werden.

Fazit

Zusammengefasst verwandelt MCP starre KI-Implementierungen in flexible, kontexthungrige Assistenten. Ein LLM, das früher nur seinen statischen Trainingsstand kannte, wird durch MCP zum lebendigen Bestandteil der Systemlandschaft: Es kann recherchieren, interagieren und vielfältige Informationsarten verarbeiten. Für Entscheider eröffnet das die Chance, KI wirklich in die breite ihrer Geschäftsprozesse zu holen, statt nur punktuelle Pilotinseln zu betreiben. Natürlich gibt es je nach Branche und Use Case unterschiedliche Anforderungen – aber das zugrunde liegende Muster ist klar: MCP stellt eine Verbindung her. Das reduziert Integrationsaufwand, schafft neue Möglichkeiten zur Automatisierung und bringt Struktur in die Anbindung von Unternehmenssystemen.

Auch für uns bei DataSpark ist MCP ein relevantes Thema. Als Anbieter von Lösungen rund um KI-gestützte Automatisierung und Agentensysteme beobachten wir, wie sich durch Standards wie MCP neue Potenziale für die Verbindung von KI und Unternehmenssystemen ergeben – technologisch und organisatorisch. Welche Rolle solche Ansätze künftig spielen, hängt vom konkreten Einsatzkontext ab, die Richtung ist aber klar: weg von isolierten Anwendungen, hin zu integrierten, systemübergreifenden KI-Lösungen.